De eerste klinische trials van Neuralink zouden een groot succes zijn. Een verlamde proefpersoon kon, na het implanteren van een Neuralink apparaat dat via elektrodes hersensignalen oppikt, een spelconsole aansturen met zijn gedachten. Communiceren we binnenkort via onze gedachten?

In januari plaatste Neuralink, het zoveelste bedrijf mede-opgericht door Elon Musk, voor het eerst een implantaat in de hersenen van een proefpersoon met een volledige verlamming. Het implantaat bestaat uit elektroden die operatief in de hersenen aangebracht worden. Dit laat toe hersenactiviteit op te vangen en er vervolgens externe apparaten mee aan te sturen.

De allereerste proefpersoon, Noland Arbaugh, een 30-jarige man die sinds een zwemincident verlamd raakte vanaf de nek, was aangewezen op het gebruik van een pen met zijn mond om te interageren met zijn digitale omgeving. Na de implantatie van de elektroden en een korte kalibratie fase kon hij een cursor aansturen met zijn gedachten.

Noland slaagde in de weken volgend op de operatie erin zijn computer te besturen, online te schaken en zelfs Mario Kart te spelen door louter de juiste actie in te beelden. Waar ligt de limiet van zulke implantaten? Ligt ook telepathie binnen handbereik?

Resultaten als deze doen wetenschappers wegdromen van vergaande toepassingen waarbij niet enkel acties maar zelfs onze gedachten rechtsreeks afgeleid kunnen worden vanuit hersenactiviteit. Recent onderzoek komt al aardig dicht in de buurt.

Met behulp van niet-invasieve opnames van hersenactiviteit (fMRI) en een GPT-taalmodel (de motor achter toepassingen zoals ChatGPT), slaagden onderzoekers erin af te leiden welke woorden en zinnen proefpersonen te horen kregen tijdens de hersenopnames en zelfs aan wat ze dachten. Wat deze resultaten zo bijzonder maakt, is dat de inhoud van de gedachten niet afgeleid werd vanuit een ingebeelde actie. De proefpersonen moesten zich dus niet inbeelden een zin uit te spreken of neer te schrijven. De inhoud van hun gedachten kon rechtsreeks worden uitgelezen vanuit het deel van de hersenen dat de betekenis van onze gedachten codeert, dus zonder de ingebeelde actie-tussenstap. Een hele winst in efficiëntie.

In zo’n toepassingen is het de taak van een taalmodel om de relatieve betekenis van een woord in een zin af te leiden. Je kan dit vergelijken met het principe van een woordenwolk, een taalmodel leert welke woorden gelijkaardige betekenissen hebben door het gezelschap waarin ze vaak voorkomen tijdens natuurlijk taalgebruik. Woorden als ‘student’ en ‘professor’ krijgen een positie dicht bij elkaar in deze woordenwolk, ‘spinazie’ en ‘trombone’ daarentegen liggen verder uit elkaar.

Het taalmodel gaat elke positie in de woordenwolk een code toewijzen, zie het als een postcode voor regio’s in de woordenwolk. In een volgende stap krijgen proefpersonen een grote hoeveelheid gesprekken te beluisteren terwijl een hersenscanner hun breinactiviteit registreert. Door de breinactiviteit tijdens het beluisteren van een woord te vergelijken met de overeenkomstige postcode van dit woord kunnen beiden gelinkt worden. Met voldoende data kan er dus een decodeersleutel vervaardigd worden die hersenactiviteit koppelt aan de corresponderende postcode in de woordenwolk. Gedachten kunnen zo uitgelezen worden.

Er zijn dus twee cruciale benodigdheden voor succesvolle telepathie: een zo groot en nauwkeurig mogelijke woordenwolk met de bijhorende postcodes (het taalmodel) én toegang tot onze hersenen. Waar staan we op deze fronten?

Prestigeproject

Op vlak van het eerste ingrediënt, een degelijk taalmodel, staan we al behoorlijk ver. Het maken van een taalmodel komt in essentie neer op het uittekenen van zo’n woordenwolk. Het model leert vanuit een kolossale hoeveelheid tekst welke woorden een gelijkaardige rol vertolken in onze taalbeleving. Hoe meer voorbeelden het taalmodel te zien krijgt, hoe beter het erin slaagt de betekenis van woorden te onderscheiden. Ook de context en de volgorde van woorden beïnvloedt welke betekenis woorden toegeschreven krijgen. Zo leert het de zinnen ‘goed dat ik lees’ en ‘lees ik dat goed’ van elkaar te onderscheiden. In de constructies, ‘hij ging naar de bank om een lening aan te vragen’ en ‘na het voederen van de eenden ging hij op de bank zitten’, krijgt bank een andere positie in de woordenwolk toegewezen.

Dit klinkt eenvoudig, ware het niet dat taal enorm complex is. Het Van Dale woordenboek omvat zo’n 250 000 woorden die op oneindig veel manieren gecombineerd kunnen worden om informatie over te brengen. Voor een computermodel om een goede inschatting te maken van de tussenliggende relaties heeft het veel input nodig, héél veel. GPT-2 werd blootgesteld aan zo’n 10 miljard woorden. De volgende generatie, GPT-3 kreeg 300 miljard woorden te verwerken, GPT-4 al zo’n 13 triljoen. Terwijl de kost om dit soort model te trainen enkel stijgt (tientallen miljoenen dollars) neemt de meeropbrengst zienderogen af. Toch gaan de technologiereuzen gretig de competitie aan om het grootste model op de markt te brengen. Is het louter een erezaak of is er meer aan de hand?

Laatste Halte: Het Brein

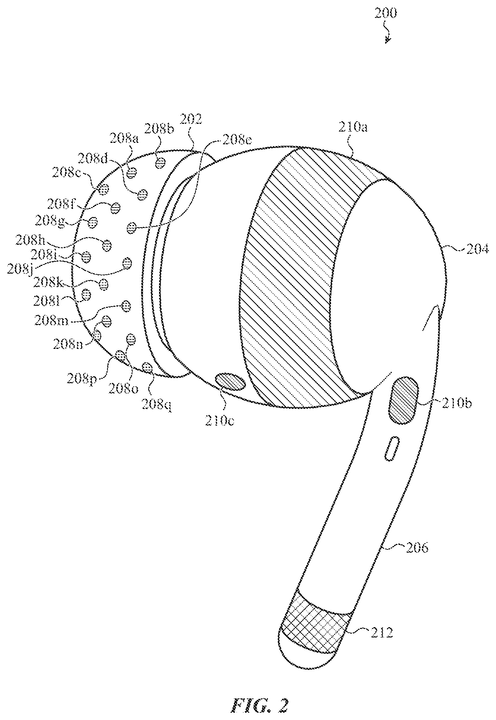

De ‘ik heb een groter taalmodel dan jou’-strijd kan deels verklaar worden vanuit een evolutie op vlak van het tweede ingrediënt, onze hersenen. Er komen steeds meer producten op de markt die in meer of mindere mate hersenactiviteit registreren. Voorlopig ligt de nadruk op neurofeedback of het monitoren van het algemene activatieniveau van ons brein (bijvoorbeeld medidatietoepassingen). Daar komt mogelijk snel verandering in. In 2023, diende Apple een patent in voor Airpods uitgerust met elektroden die hersenactiviteit kunnen meten. Sommigen speculeren ook dat toekomstige versies van de Apple Vision Pro elektroden zouden bevatten.

Er lijkt dus een spacerace aan de gang te zijn met onze hersenen als de maan. De combinatie van steeds performantere taalmodellen en betere toegang tot onze hersenactiviteit lijkt de weg te banen voor een toekomst waar telepathie niet langer uitgesloten is.

Het voornaamste obstakel in de weg van zo’n toekomst is de omvang van het taalnetwerk in de hersenen. Betekenis komt niet tot stand in één specifiek hersendeel, het is het resultaat van een complex samenspel over uiteenlopende hersengebieden. Toegang tot deze gebieden en het vlot ontcijferen van hun inhoud blijft voorlopig nog toekomstmuziek. Telepathie is nog niet voor morgen.

Doemdenkers kunnen we alvast geruststellen. Onderzoekers slaagden er niet in de gedachten af te lezen van proefpersonen die actief trachtten hun gedachten te verhullen.

Referenties

Azemi, E., Moin, A., Pragada, A., Lu, J. H.-C., Powell, V. M., Minxha, J., & Hotelling, S. P. (2023). Biosignal Sensing Device Using Dynamic Selection of Electrodes (United States Patent US20230225659A1). https://patents.google.com/patent/US20230225659A1/en

Neuralink. (2024, May 8). PRIME Study Progress Update—User Experience. Neuralink Blog. https://neuralink.com/blog/prime-study-progress-update-user-experience/

Tang, J., LeBel, A., Jain, S., & Huth, A. G. (2023). Semantic reconstruction of continuous language from non-invasive brain recordings. Nature Neuroscience, 26(5), Article 5. https://doi.org/10.1038/s41593-023-01304-9